Im E-Commerce Sektor gewinnt Künstliche Intelligenz zunehmend an Aufmerksamkeit. Neben der Automatis...

- Agentur (55)

- norisk (25)

- Onlinemarketing (16)

- E-Commerce (13)

- Team (12)

- Unternehmen (10)

- Wissen (8)

- SEA (6)

- Adword Scripts (3)

- Awards (3)

- Events / Messen (3)

- in den Medien (3)

- KI (2)

- SEO (2)

- Allgemein (1)

- Design (1)

- Events (1)

- Marketing (1)

- Marketing Technology (1)

- Works (1)

- norisk Group Expert (1)

- shoptimax (1)

"Circle to Search" ermöglicht es den Nutzern, durch einfache Gesten wie Kreisen, Markieren, Kritzeln...

Angenommen ein Nutzer klickt auf einen Link oder ein Suchergebnis bei Google. Man freut sich darauf,...

AI-Generated Image Kennzeichnung im Google Merchant Center Warum die Kennzeichnung von AI-Generated ...

Google Update zum Einwilligungsmodus Version 2: Deadline März 2024 Die digitale Marketinglandschaft ...

Bester Shop 2023: Sport Schuster erobert E-Commerce Awards mit 3-fach Sieg Der Vollsortimenter und A...

Ein Traditionshaus mit Blick auf Innovation Schon vielfach hat die norisk Group unter Beweis gestell...

Gipfel der Customer Experience: Omnichannel Relaunch bei Sporthaus Schuster Der Münchner Outdoor- un...

Umsatz ist nicht gleich Umsatz! Warum gleiche Zahlen nicht denselben Wert für Unternehmen und Marke ...

Umsatz ist nicht gleich Umsatz! Warum gleiche Zahlen nicht denselben Wert für Unternehmen und Marke ...

K… wie Kunde – das norisk K5 2023 Recap “Nothing changes, if nothing changes.” lautet die offizielle...

OMR 2023 - Unser Recap Die OMR23 erwies sich erneut als eines der bedeutendsten Events der digitalen...

Google Bidding Strategien: Teil 7 – Conversion-Wert maximieren Im siebten Teil unserer Serie zu den ...

NORISK ERWEITERTE FÜHRUNGSRIEGE Die E-Commerce Enterprise Agentur norisk vergrößert ihr Management D...

Renommierter Münchner E-Commerce Realisierer wächst weiter! norisk integriert biering online und bau...

Analyse: Performance Max Kampagnen Anfang des Jahres kam die vermeintliche Hiobsbotschaft für alle F...

Drei Glaubenssätze, die dein Onlineshop Projekt ruinieren Warum Mindset (und nicht Technologie) über...

Omnichannel oder Multichannel? – Wie Retailer das richtige Konzept finden. Die Wahl der Kanäle entsc...

Ideen gegen das Sommerloch im E-Commerce Die hohen Temperaturen machen auch vor dem Onlinehandel nic...

Google Bidding Strategien: Teil 8 – Sichtbarer CPM Im achten Teil unserer Serie zu den Smart Bidding...

Google Bidding Strategien: Teil 6 – Conversions maximieren Im sechsten Teil unserer Serie zu den Sma...

NoriskGroupexpert: Christoph Kurz Christoph Kurz aka. „Kurzi“ ist schon seit 10 Jahren Teil der nori...

Google Bidding Strategien: Teil 5 – Klicks maximieren Im fünften Teil unserer Serie zu den Google Bi...

noriskGroupExpert: Maja Veselinovic Maja Veselinovic ist seit schon seit 10 Jahren Teil der norisk G...

Google Bidding Strategien: Teil 4 – Ziel-ROAS Bei Smart Bidding handelt es sich um eine Untergruppe ...

#noriskGroupExpert: Martin Odenbach Martin Odenbach ist seit 2019 Teamlead Marketing & Partner M...

Google Bidding Strategien: Teil 3 – Ziel-CPA Google Ads hat in den vergangenen Jahren das Angebot an...

Die Rolle der Datenanalyse im E-Commerce Big Data: ein Buzzword, das in aller Munde ist. Kein Wunder...

noriskGroupExpert: Domenic von Tryller Domenic von Tryller ist seit 2017 Teil der norisk Group. Als ...

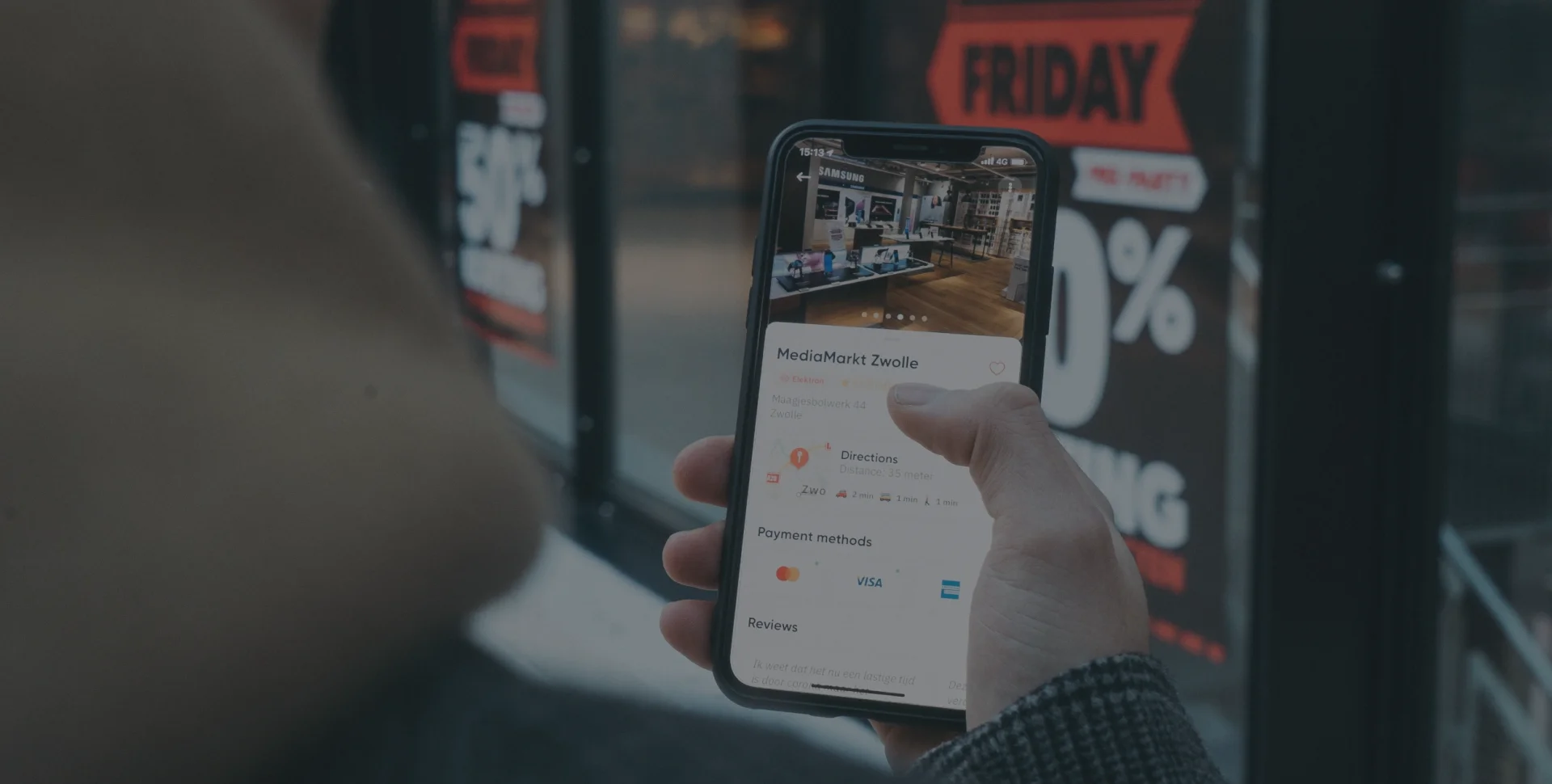

Das phygitale Einkaufserlebnis E-Commerce und Einzelhandel verschmelzen aus Kundensicht immer mehr m...

noriskGroupExpert: Alexander Groß Alexander Groß ist unser Teamlead Tech & Data. Er kümmert sich...

noriskGroupExpert: Christian Elsner Christian Elsner ist einer der beiden Gründer und CEOs der noris...

noriskGroupExpert: Thomas Heinig Thomas Heinig ist seit Dezember Teamlead Frontend Development in de...

DIE OMNICHANNEL-STRATEGIE Produkte über mehrere Vertriebskanäle zu verkaufen, ist längst nichts Neue...

noriskgroupexpert: André Zaharias André Zaharias ist seit 2011 Teil der norisk Group. In unserem Dev...

Agentur-Merger: biering online wird in die norisk Group eingegliedert München, 30. November 2021: Na...

noriskGroupExpert: Ivana Nikic Ivana Nikic ist seit 2018 Teil der norisk Group. Als Head of Onlinema...

noriskGroupExpert: Leon Bechhaus Leon Bechhaus ist seit 2019 Frontend Developer in der norisk Group....

Employer Branding: Wie finden wir passende Talente? Wir sind Profis darin, unsere Kundenprojekte zu ...

noriskgroupexpert: Mark büchner Mark Büchner ist seit Oktober unser Head of Project Operations. Zur ...

Nudelmaschine statt Tischtennisschläger Zwar zeigt die Frequenz in den deutschen Innenstädten einen ...

Die E-Commerce Agentur norisk Group wird Teil von MYTY München, 15.07.2021 – das Agenturnetzwerk MYT...

Google Bidding Strategien: Teil 2 – Angestrebter Anteil an möglichen Impressionen “Aus den Augen, au...

Google Bidding Strategien: Teil 1 – Manueller CPC Es gibt viele verschiedene Gebotsstrategien für Go...

Kostenloser Google Shopping Traffic: alle Bedingungen und Zahlen Kostenloses Google Shopping gab es ...

Mit Google Discover auf position -1 Position -1? Was soll das sein? Und falls es etwas Gutes ist, wi...

GOOGLE ADS: ÄNDERUNG DER SUCHBEGRIFFE Vor einigen Tagen wurde Google Ads neuste Änderung bekannt: Se...

Google Local Inventory Ads (LIA): Wie effektiv sind sie wirklich? Bereits vor einiger Zeit brachte G...

Manager Magazin Podcast mit CEO Christian Elsner: Arbeitspioniere: Gelebte New-Work-Konzepte Die Anf...

SPENDEN STATT SCHENKEN Zum Jahresausklang 2019 setzt die norisk Group ihre Tradition fort, von großz...

Am 11. April fand das alljährige SEACamp im Steigenberger Esplanade in Jena statt. Zum siebten Mal k...

norisk solutions GmbH verschmilzt mit norisk GmbH Die norisk GmbH, eine der führenden Enterprise E-C...

Aus shoptimax wird norisk solutions Die norisk GmbH erhöht ihre Beteiligung an der shoptimax GmbH au...

norisk Group vereint 4 Spezialagenturen unter einem Dach Aus vier mach eins: die norisk Group verein...

RECAP: norisk @OXID Commons 2018 Die OXID Commons gilt als eines der wichtigsten Branchentreffen aus...

AUSBILDUNG: KAUFLEUTE IM E-COMMERCE Mit Beginn des Ausbildungsjahres 2018 wird der speziell für den ...

norisk „Best Agency of the Year“ 2018 bei den E-commerce Awards Berlin Am 15.02.2018 haben sich in B...

Negative Keywords für Google Shopping mit AdWords Scripts automatisieren TL;DR: Dieser Artikel besch...

Exklusive Einblicke: Der neue Onlineshop von kaffeekontor.org München, 14.09.2017: Im Showroom Freib...

NORISK HAT GETESTET: OXID eSHOP 6 Bereits seit Anfang 2017 ist OXID eShop 6 als Beta-Release für die...

Shoppingfeed Monitoring mit AdWords Scripts: Fehler & Potentiale auf einen Blick TL;DR: Dieser A...

Finale! Alexander Groß tritt beim Analytics Award an München, 10.05.2017: Alexander Groß, seines Zei...

OnPage.org API mit Google Docs und Apps Skripts nutzen: So geht’s *** TL;DR: Dieser Artikel beschrei...

Automatisierung aus einer Hand – Willkommen zum norisk ScriptLab! Wir haben in den letzten 3 Jahren ...

norisk group beteiligt sich an shoptimax Die Multichannel-Commerce Agentur norisk gibt heute ihre Be...